2019年5月15日

2019/6/4〜6/7 JSAI 2019で2件の研究を発表します

2019年6月4日(火)〜6月7日(金)に新潟で開催される人工知能学会全国大会(JSAI)で2件の研究発表を行います。また、展示ホールに常時ブースを出展しており、本社のサマーインターン募集や採用情報について説明を行いますので、お気軽にお立ち寄りください。

発表1. ConvRNNの計算量を削減

畳み込み再帰ネットワーク(ConvRNN)の計算負荷を20〜40%減らしつつ、精度劣化は1〜2%に抑える手法を発表します。

発表2. ファイナルバッチ正規化

浮動小数点数には見られず、量子化した低ビットなネットワークに特異的に見られる振る舞いを利用した、これまでより優れたバッチ正規化法を発表します。

1. ConvRNNの計算量を削減

公式情報:講演情報 講演日時:2019年6月5日(水) 16:40 〜 17:00 講演会場:H会場 (303+304 小会議室) 講演番号:国際セッション:[2H4-E-2-05]

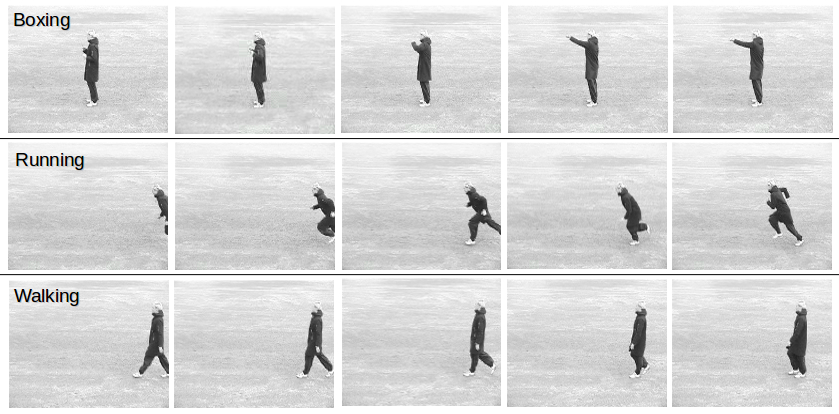

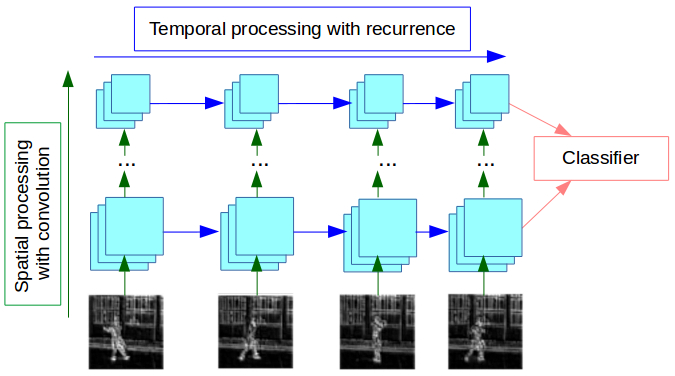

D. Vazhenina and A. Kanemura、“Reducing the number of multiplications in convolutional recurrent neural networks (ConvRNNs)”、人工知能学会全国大会(JSAI)、新潟、日本、2019。 深層学習は、行動認識 (図1)や天気予報 (図2)などの時空間モデリングにも使われており、未来の出来事の予測などに有用であると期待されています。時空間モデリングを深層学習で行った代表的な手法にConvRNNがあります。ConvRNNは、RNNによる時系列処理と、畳み込みによる2次元データ(画像)処理を組み合わせた革新的な手法です (図3)。ただし、ConvRNNには計算負荷が大きいという技術的な課題があります。ConvRNNが必要とする計算量は、映像解析や行動認識のような実世界のアプリケーションを運用することが困難なほど大きくなってしまっています。

そこで我々は、ConvRNNの計算負荷を減らす手法を開発しました。アイディアは単純であり、パラメータと乗算の数を減らすために、畳み込み演算をアダマール積(要素積)で置き換えるというものです。その代償として精度が低下することが予期されたので、具体的なデータとタスクに対して定量的に評価しました。データはMoving MNISTを、タスクとしてはのビデオフレーム予測を用いました。我々の手法は、畳み込み演算を用いるConvRNNと比較して、パラメータ数は21%減少、乗算回数は38%減少させることができました。懸念された精度低下は、SSIM (structural similarity index)で約1.5%減少と、計算負荷の軽減に比べて非常に少ない劣化にとどまりました。ConvRNNのような時空間モデリング法を、Webアプリや組み込みシステムなどのさまざまな状況でより便利に使えるように我々は研究開発を続けています。詳しくはJSAIのWebサイトで公開される我々の論文をご覧ください。(JSAI2019予稿集)

図1:ヒトの行動の画像系列データ(KTH datasetより)。

図1:ヒトの行動の画像系列データ(KTH datasetより)。

図2:レーダー反射波からの降雨量の予測([1]のsupplementary materialデータより)。

図2:レーダー反射波からの降雨量の予測([1]のsupplementary materialデータより)。

図3:ConvRNNを使った識別器のアーキテクチャ([2]のFigure 2より改変の上引用)。

図3:ConvRNNを使った識別器のアーキテクチャ([2]のFigure 2より改変の上引用)。

[1] S. Xingjian, Z. Chen, H. Wang, D. Yeung, W. Wong, and W. Woo. Convolutional LSTM network: A machine learning approach for precipitation nowcasting. In Neural Information Processing Systems (NIPS), 2015.

[2] Nicolas Ballas, Li Yao, Chris Pal, and Aaron Courville. Delving deeper into convolutional networks for learning video representations. International Conference on Learning Representations (ICLR) , 2016.

2. ファイナルバッチ正規化

公式情報:講演情報 講演日時:2019年6月5日(水) 16:40 〜 17:00 講演会場:A会場(2F メインホールA) 講演番号:国際セッション:[2A4-E-2-05]

J. Nicholls and A. Kanemura、“Final sample batch normalization for quantized neural networks”、人工知能学会全国大会(JSAI)、新潟、日本、2019。 バッチ正規化(batch normalization)は、ReLUと並んで深層学習で中核となる技術です。バッチ正規化により、当時のImageNetコンペティションの優勝者を上回る性能(トップ5エラーが5%未満)が達成されました[3]。現代の深層学習のモデルではバッチ正規化は標準的に採用されています。

我々は、深層学習のモデルを小さくする研究を行う過程で、バッチ正規化は、量子化ネットワークに対しては通常と異なる振る舞いをすることに気がつきました。この発見が、バッチ正規化に関する新しい手法に繋がりました。

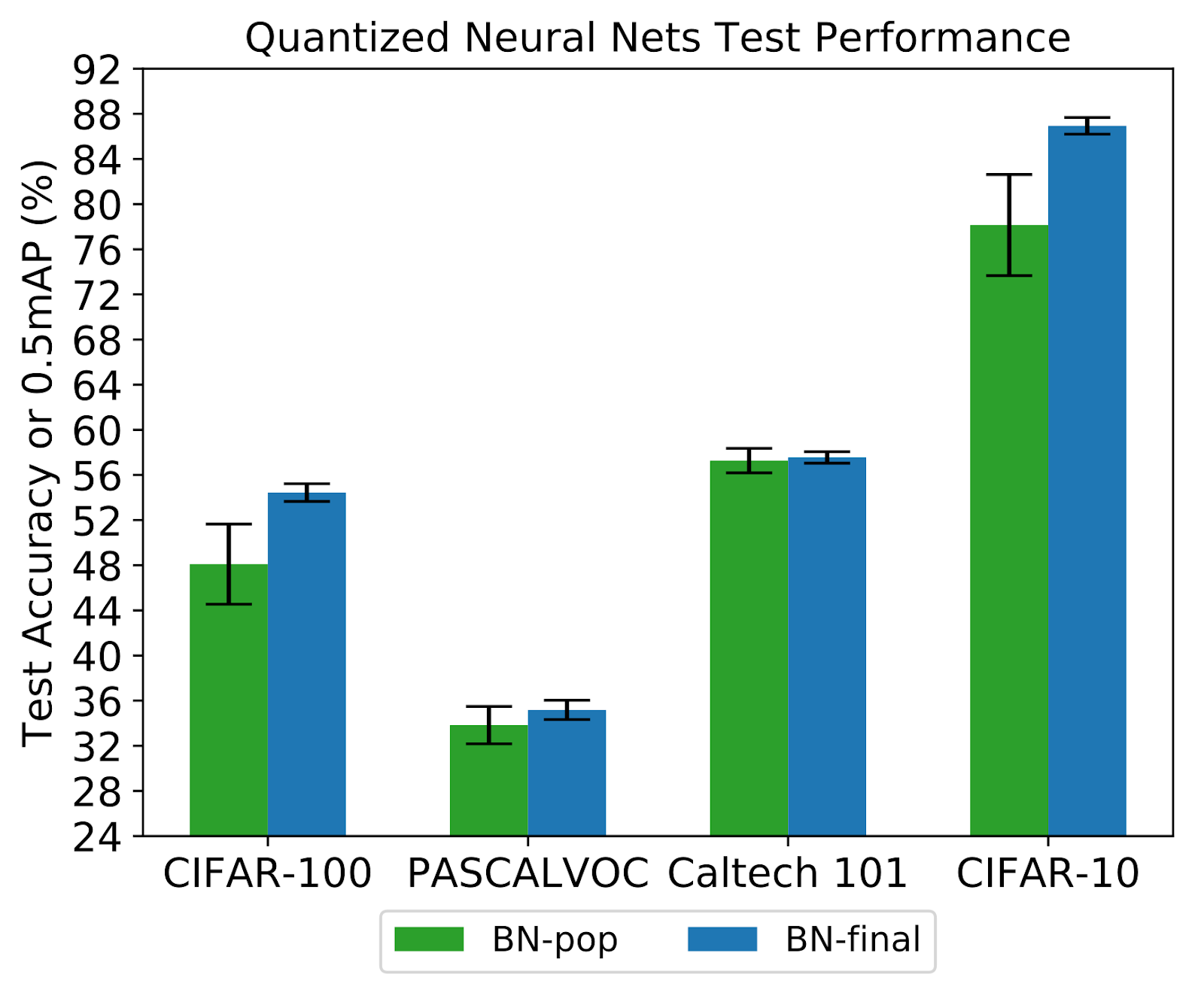

今回の発表では、BN-final (final batch normalization)と名付けた手法を報告します。BN-finalは、量子化ネットワークに対して、これまでのバッチ正規化よりも優れた性能を示します。BN-finalでは、全てのバッチからの統計量の代わりに、最終バッチからの統計量のみを使用して、バッチ正規化を行います。 BN-finalの有用性を検証するために、分類や物体検出のタスクを含む一連の実験を行いました。下の図に示す通り、4つのデータセット全てについて改善がみられ、なかでもCIFAR-10に対しては精度が80%から88%まで10%(8ポイント)程度上昇しました (図4)。また、学習中のテスト精度の変化がより滑らであることなどもわかりました。詳しくはJSAIのWebサイトで公開される我々の論文をご覧ください。(JSAI2019予稿集)

図4:BN-final(青色)は、標準的なバッチ正規化法BN-pop(緑色)よりも優れた性能を示しました。

図4:BN-final(青色)は、標準的なバッチ正規化法BN-pop(緑色)よりも優れた性能を示しました。

[3] S. Ioffe and C. Szegedy, “Batch normalization accelerating deep network training by reducing internal covariate shift”, International Conference on International Conference on Machine Learning (ICML), Lille, France, 2015.

JSAI学会にて企業出展のお知らせ

学会のスポンサーとして、6月4日(火)から6月7日(金)まで会場にブースを設置いたします。ブース内では、弊社の最新情報とサマーインターン募集や採用情報について紹介いたします。ご参加の際にはぜひ弊社ブースまでお立ち寄りください。

会 場

展示会場 A:1F 展示ホールB A-8

出展日時

6月4日(火) 13:00~17:00 6月5日(水) 9:00~17:00 6月6日(木) 9:00~17:00 6月7日(金) 9:00~15:00

【サマーインターン募集中】

2019年、夏。LeapMindで技術インターンをしたい、Deep Learningに興味のある学生を募集します!

LeapMindは、意欲的な学生の方々を対象に、サマーインターンを募集します。LeapMindは、深層学習を世の中のあらゆるモノに実装し、より便利で豊かな社会を実現することを目指し、低ビットのコンパクトなニューラルネットを作成するオープンソースソフトウェアBlueoilの開発や、低消費電力で稼働するディープラーニング向けの独自プロセッサの設計などを進めています。Blueoil開発、プロセッサ設計、その他のプロジェクトに参加し、先端技術を社会に届ける一端をになってみませんか。